算力爆发!AI产业等来了它的“iPhone时刻”?

经济基础决定上层建筑,而如今,算力基础决定上层应用。

3月14日,OpenAI推出GPT-4.0,相比当前Chat GPT使用的GPT-3.5,增加了输入图像的功能;扩写能力增强,能处理超过25000个单词的文本;更具创造力,并且能够处理更细微的指令。

3月16日,百度正式推出对标ChatGPT的生成式对话产品“文心一言”。

华为老总任正非说:ChatGPT对我们的机会是什么?它会把计算撑大,把管道流量撑大,这样我们的产品就有市场需求。

GPT模型迭代的背后,是参数量及训练量的指数级增长,是AI从实验技术成长为稳定生产力。这这些AI大模型的发展,对算力的需求每两个月增加一倍。仅OpenAI,每年的支出费用就高达10多亿美金。

-

算力为何如此重要?

-

算力背后的支撑

-

受益行业及相关机会

报告酱梳理了多篇报告,将从与大家分享上述三个问题的答案。

算力为何如此重要?

算力,也就是计算机的运算能力。具体指硬件对数据收集、传输、计算和存储的能力。

算力的大小表明了对数字化信息处理能力的强弱,常用计量单位是 FLOPS(Floating-point operations per second),表示每秒浮点的运算次数。

运算量(FLOPS)的数值通常与参数量(parameter count)成比例,不同模型架构的换算关系不同。模型越复杂、参数量越大,所需计算量越大。

在联想年初发布的影片《万有新力》中,是这么描写算力的:“你看不见我,而我,存在于每个地方...我在你看到和看不到的任何地方,心无杂念地计算,我所有的力,向万物敞开,我愿尽我所能,给你以力,重组想象,用一天,替你完成几十年的工作...”。

由此可见,算力的强大之处。

人工智能行业中,算力、算法、数据是三个核心概念,是构成AI领域的基础设施。随着技术的进步,应用场景的不断拓展,“三大金刚”将推动整个行业的创新和发展。

-

算力(Computing Power)包括CPU、GPU、FPGA、ASIC等AI芯片。云计算技术和5G通信技术的发展,让算力的分布和调度更加灵活,有助于满足各种场景下对高性能计算的需求。

-

算法(Algorithm)是一系列解决问题、实现特定功能的有序指令和步骤。在AIGC行业中,算法是模型的基础,用于实现数据分析、人工智能模型训练等功能。

-

数据(Data)是支撑决策和优化的基础,是算法发挥作用的前提。大数据技术可以对海量数据进行有效处理、分析和存储,而人工智能技术可以通过对数据进一步学习,实现各种智能化应用,如图像识别、自然语言处理等。

随着我们走进数字时代,计算场景更加丰富,在中国乃至全球范围内算力需求也随之提高到了前所未有的高度。据中国信息通信研究院,2021年全球计算设备算力总规模达到615EFlops, 增速为 44%;预计到 2030 年,全球算力总规模将实现 56ZFlops,平均年增速将达到65%。

作为总规模位居全球第二的国家,我国算力需求同样处高速增长态势。工信部数据显示,2020 年我国算力总规模达到135EFlops,占全球总规模的31%,截至2022年6月底,我国算力总规模超过150EFlops,年均增速超过35%。

如果算力能够大踏步地发展,在成本不变的情况下,把算力提升千倍万倍,比ChatGPT更高级别的智能就一定会出现。

算力背后的支撑

从OpenAI发布GPT-4,百度发布文心一言,再到微软发布Office的AI助手Microsoft 365 Copilot,以及Midjourney发布能“画手指”的V5版本,谷歌的Bard聊天机器人开始排队测试...在这个AI行业的关键时刻,“卖水人”英伟达赢麻了。

前天晚上11点,2023春季GTC大会正式上线,英伟达大佬黄仁勋围绕AI、量子计算、芯片等前沿科技,发布了一系列前沿技术和产品。但最亮眼的,当属一块支撑ChatGPT算力、提速10倍的H100 NVLINK芯片,大佬就差把“我最牛”写在脸上。

在这之前,黄仁勋曾表示ChatGPT是人工智能(AI)的iPhone时刻(an iPhone moment),可说是运算领域有史以来最伟大的一刻。

根据OpenAI数据,GPT-3 XL参数规模为13.2亿,训练所需算力为27.5PFlop/s-day。由于ChatGPT是在13亿参数的Instruct GPT基础上微调而来,参数量与GPT-3 XL接近,因此预计ChatGPT训练所需算力约为27.5PFlop/s-day。

以NVIDIA V100芯片为例,一颗NVLink版本V100芯片的深度学习算力为125TFlops,则ChatGPT模型的训练,至少需要1颗V100芯片计算220天才能完成。

随着模型参数的不断增加,模型训练所需算力将进一步提升,将进一步拉动对算力芯片的需求。

可以看出,AI芯片是ChatGPT的底层土壤。

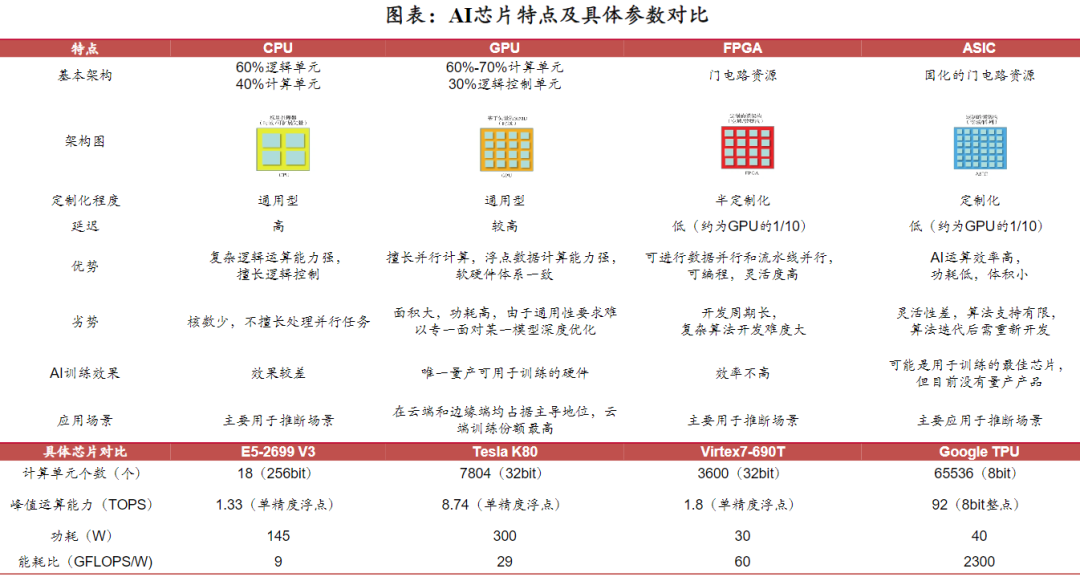

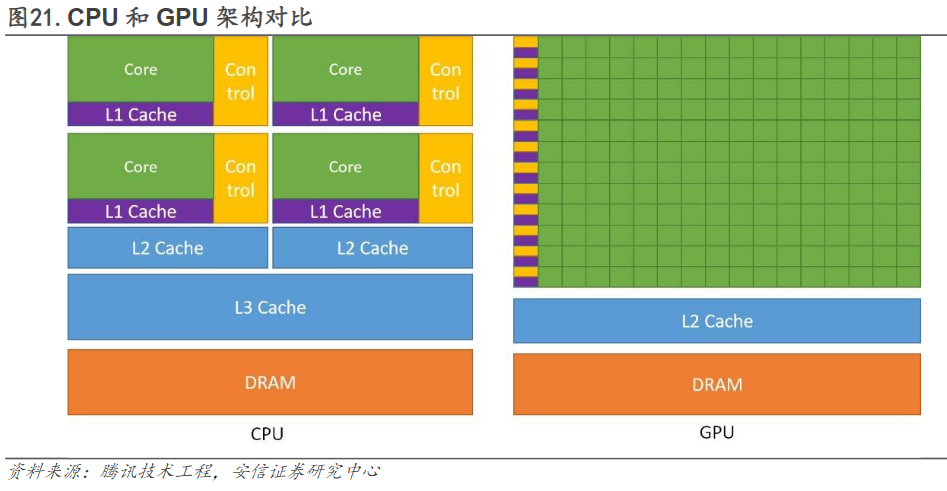

如下图,AI芯片主要分为CPU、GPU、FPGA和ASIC四类,CPU是AI计算的基础,GPU、FPGA、ASIC作为加速芯片协助CPU进行大规模计算。

随着多样化智能场景的出现,需求的多元化也对算力的多样化提出要求。如果把总算力换成公式来看:总算力=单个芯片的计算量*芯片个数*实际功率。可以简单地假设为,不同的芯片排列,可以有不同的计算能力。

英伟达CUDA架构,正是引领了GPGPU(通用图形处理器)开发市场,打造了算力底座的核心护城河。

如果举一个例子进行对比的话,CPU类似于公务员体系中的一个部门,不同职位间的工作人员互相帮忙,互相协作,最终解决一个复杂的问题;而GPU类似于加工厂,很多人在很多时刻只干着同一份工作。

目前CPU+XPU异构形式成为AI服务器主流架构,XPU包含了GPU、FPGA、ASIC等,这样的组合可以提供更强大的计算能力,实现计算任务的高效处理和资源的最优利用。

硬件方面,运算量取决于GPU运算执行时间的长短,而参数量取决于占用显存的量。内存和功耗,也是目前掣肘AI行业的两大问题。

如果能够解决上述问题,将极大提高算力的水平。现存的方法有大致四种:存算一体技术、HBM技术、Chiplet技术、CPO技术。

期待未来更多技术的提升,让算力腾飞。

受益行业及相关机会

历史上,每轮大规模反垄断均伴随生产要素垄断,并孕育新的产业革命。当前,我们正处于第三轮反垄断进行时:

-

首轮浪潮始于19世纪末,伴随一战开始暂告段落,主要针对工业巨头对资源要素的垄断,与之相伴随的是第二次工业革命;

-

第二轮浪潮始于80年代,伴随2000年美国互联网泡沫的到来告一段落,主要针对科技巨头对技术要素的垄断,与之相伴随的是信息革命;

-

第三轮浪潮始于近两年,当前仍处于第三轮反垄断浪潮进行时,主要针对数字经济巨头对数据要素的垄断。如果本轮反垄断行之有效,则未来数据要素生产空间的释放,或将催生新一轮产业巨头。

从过往历轮反垄断经验来看,数据生产要素的释放将利好“数据密集型”产业。

长期看,一波以大数据、云计算、物联网、人工智能为基础的科技革命已在酝酿。当前人工智能发展的核心瓶颈是数据,未来国家归集数据要素供其使用后,预计技术迭代速率将明显加快。

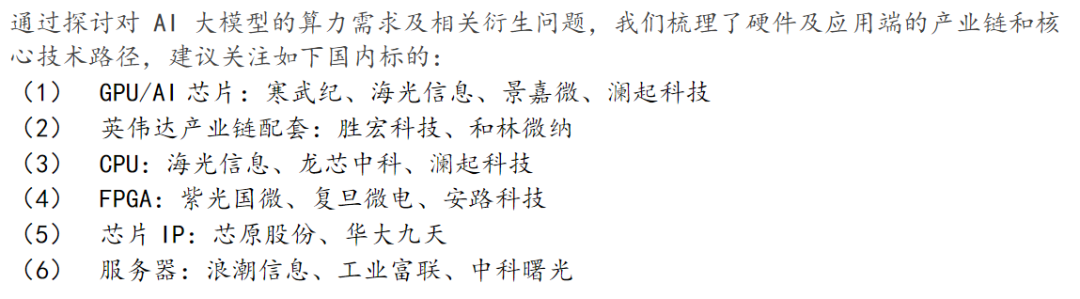

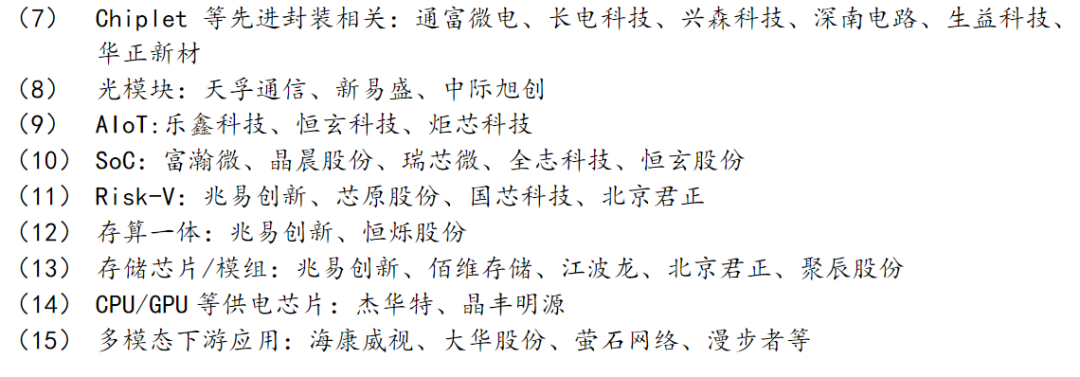

二级市场的投资机会方面,可以参考安信证券的观点,关注国产大算力芯片、英伟达/AMD产业链、上游硬件供应商、下游多模态应用落地等。

#你认为算力的黄金时代来了吗?

发现报告商业局

发现报告旗下传递新经济商业知识的阵地。

我们需要先了解这个世界,才能思考,或创造。

系列文章推荐

手握剧本的英伟达还能狂飙多久?

2024-02-29

6篇报告读懂AI大模型

2023-04-27

从ChatGPT到AIGC,一文详解产业链

2023-02-16

聊聊你知道和不知道的ChatGPT

2023-02-08

2022,那些不容忽视的技术趋势

2022-05-10

十篇深度报告,迅速了解中国AI产业

2022-03-28

8篇报告 我读懂了新基建七大领域

2022-02-25

东数西算空间有多大?涉及哪些产业链?(附报告)

2022-02-23

一文读懂元宇宙、NFT、GameFi、DAO、算力...(附报告)

2021-12-18

人工智能的黄金时间点来了!全文解析机会热点

2021-06-18